Spécialiste de l’œuvre de Zanis Waldheims. Biologiste et éducateur en milieu postsecondaire, conférencier. Il travaille depuis 2011 à décoder le système de la géométrisation de la pensée de Zanis Waldheims en collaboration avec Yves Jeanson, héritier et conservateur de l’ensemble de la collection et des archives. Il s’intéresse particulièrement au sens philosophique, psychologique et esthétique du « Schéma de l’entendement »de Zanis Waldheims pour développer une pédagogie éducative pour adultes qui facilite l’interprétation et la promotion des œuvres d’art abstrait et géométrique. En 2018 il a présenté en collaboration avec Yves Jeanson l’art et la philosophie de Waldheims dans le contexte de l’exposition internationale Portable Landscapes au Musée national des arts de Lettonie à Riga.

Abstract

En ces jours de questionnement de l’impact de l’intelligence artificielle (IA) sur la sécurité pour l’humain, nous avons un devoir de prendre conscience de notre responsabilité sociale dans cet enjeu. La conscience résulte d’un processus évolutionnaire qui, selon Piaget, vient réaffirmer la notion d’une conscience génétique, à la fois raffinée et épanouie. Teilhard de Chardin propose que la « montée de conscience » s’élève en altitude pour élargir nos horizons en sortant de la biosphère pour entrer dans la « noosphère » retrouvée au zénith de sa progression. L’artiste et philosophe Zanis Waldheims (1909-1993) a constaté que « c’est voir là, toute l’histoire de la conscience qui devient véritablement conscience qu’à son dernier niveau supérieur, c’est-à-dire seulement qu’une fois que toute l’expérience de la vie est épuisée ». Sommes-nous arrivés à ce sommet où l’IA prends les dessus sur la conscience humaine? La sélection naturelle favorise-t-elle cette forme ultime de la conscience? Certains préconisent que l’IA permettra de résoudre les maux de la société tandis que d’autres nous avertissent d’une dystopie imminente. Cette analyse vient proposer une réconciliation téléologique de ces perspectives par l’entremise d’une cybernétique éthique et d’une géométrie exhaustive pour proposer le développement d’une conscience ultime.

REY–ES–02113–LA: Ernest Septimus Reynolds, Hygiene For Beginners, Macmillan, 1936. Les biblio-graffitis de Roy Gold (1918-2008), artiste outsider de sa collection de livres. Par Nicholas Jeeves (designer, écrivain et professeur à l'école d'art de Cambridge), in D. Graham Burnett éditeur de la série Conjectures, Revue du domaine public (Mai, 2018).

I.A. la conscience ultime ?

L’intelligence artificielle (IA) est présente et à notre service. Pendant que nous découvrons son potentiel, elle se cache de l’autre côté de l’écran de nos appareils, elle nous épie, nous identifie et compile des données sur notre existence quotidienne. Elle nous géolocalise lorsqu’on consulte la météo, nous propose les menus de restaurants à proximité et nous protège lors de trajets en voiture dotée de systèmes de sécurité autonomes. En tant qu’intelligence générative, elle répond à nos questions par l’entremise de robots conversationnels, elle active et gère des appareils par la reconnaissance vocale. Elle se souvient de nous. On sait qu’elle apprend, recombine l’information et génère de nouveaux textes et images à l’aide d’algorithmes raffinés et paramétrables. L’IA évolue à un rythme effréné au point que certains disent qu’elle a le potentiel de se développer une conscience. Est-ce que cette conscience représente l’évolution naturelle de la conscience humaine ? Deviendra-t-elle la conscience ultime ?

Maints espoirs sont placés dans les progrès de l’IA pour nous aider face aux divers défis sociaux, environnementaux et économiques. Elle contribue aux avancées en médecine, l’amélioration de la sécurité routière, l’automatisation de tâches, la prévision de catastrophes naturelles, à surmonter les barrières linguistiques, somme toute, aider aux humains à interagir entre eux et dans leur environnement. Au fil des années, nous nous sommes évolué un style de vie qui s’apparente à la science-fiction d’Isaac Asimov où les robots sont au service des humains et que leurs interactions améliorent la qualité de vie. Le défi actuel de l’IA est de voir comment il peut devenir un outil de communication et de pensée avec le potentiel de transcender les différences en toute objectivité pour se mériter une acceptation universelle qui favorise ultimement la sécurité et la justice pour toute la société.

Il reste que l’alerte est sonnée depuis quelques années chez les concepteurs et chercheurs en IA. Dès les débuts de la science cybernétique au milieu du 20ième siècle, Norbert Wiener nous a mis en garde que « la cybernétique est une arme à double tranchant, tôt ou tard, elle vous blessera profondément » [1]. On entend fréquemment que l’IA peut mener aux pertes d’emplois, aux préjudices du biais et de la discrimination, à la manipulation de l’information, aux brèches de la vie privée, à la militarisation des robots et à la déshumanisation de la société. Sur le plan esthétique, l’IA a la capacité d’émuler les grands maîtres de l’art pour générer de nouveaux tableaux inspirés du style des artistes sur demande mais qui remettent en question les enjeux de la créativité et des droits d’auteurs [2]. Ces défis relèvent le besoin de se pencher sur nos attentes et les rapports entre cette entité « pensante » et notre existence pour en déterminer les réels potentiels et menaces.

La quête d’un langage universel, de systèmes et d’outils mathématiques pour le traitement de l’information retourne aux idées des philosophes du 17ième siècle. Leibniz voulait concevoir une machine à penser, le calculus ratiocinator, qui pourrait résoudre des problèmes à partir d’un système de logique symbolique. Descartes explorait la possibilité de systématiser la pensée aussi rigoureusement que l’algèbre et la géométrie pour en exposer les vérités universelles. Plus récemment, Bertrand Russell et Alfred Whitehead ont affiné des principes de logique de la pensée dans leurs Principia Mathematica. Ces bases de rationalisation et de mathématisation de la pensée ont jeté des bases importantes menant à l’arrivée des ordinateurs avec lesquels nous déployons la capacité de cryptanalyse des données au point que les avancées cybernétiques prennent leur élan ultime. L’IA évolue et prend sa place dans notre monde.

Ajoutons à ces progrès technologiques, la tendance à anthropomorphiser l’IA en lui attribuant des qualités humaines puisqu’elle devient une extension de nos capacités. L’Homo sapiens comme espèce s’est distingué par son utilisation d’outils pour améliorer sa condition de vie. La loi naturelle formulée par Darwin démontre incontestablement que la survie dépend de la capacité de s’adapter et d’affronter les défis de façon plus efficace. Piaget a de son côté établi les bases que la pensée et la conscience ont une nature génétique qui est sujette à se développer selon des principes évolutifs. Teilhard de Chardin de son côté propose que la « montée de conscience » s’élève en altitude pour élargir nos horizons en sortant de la biosphère pour entrer dans la « noosphère » retrouvée au zénith de sa progression. Est-ce que la conscience de l’IA se trouve au-delà de ce sommet ?

Un ultime modèle géométrique de la conscience

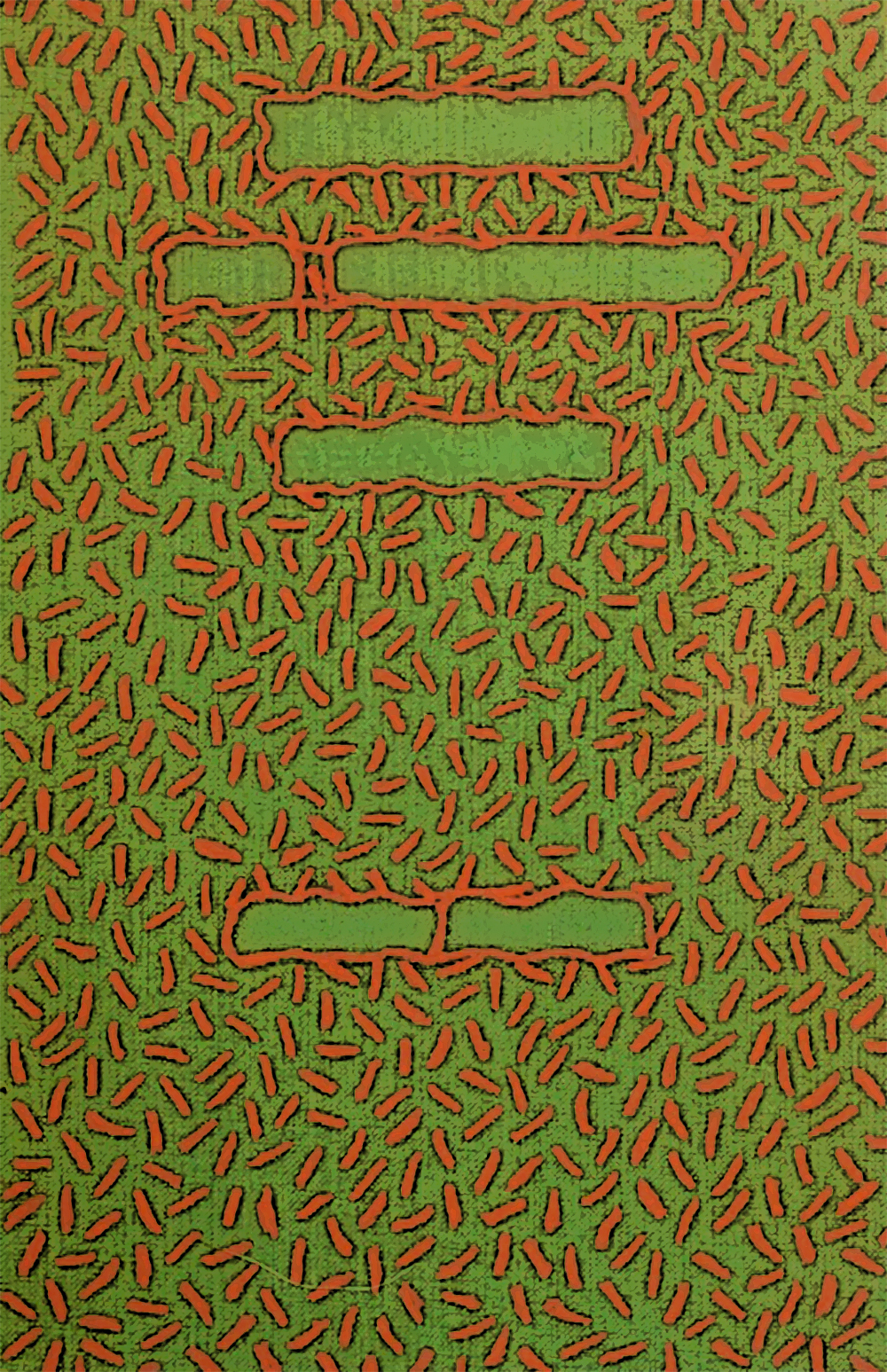

Sans ouvrir un débat exhaustif sur la définition de ‘’conscience’’, nous utiliserons ici un modèle géométrisé par Zanis Waldheims [3]. Après avoir immigré de Lettonie au Canada en 1952, il a consacré plus de trente ans à une recherche épistémologique sur les courants scientifiques, psychologiques, historiques et philosophiques. Parmi ses œuvres, on retrouve sa version de la Noosphère (Figure 1) qu’il dessine telle une pyramide organique qui place la conscience à son sommet comme résultat évolutionnaire à partir des origines moléculaires à sa base.

Figure 1. La Noosphère (#142), Zanis Waldheims, 1967.

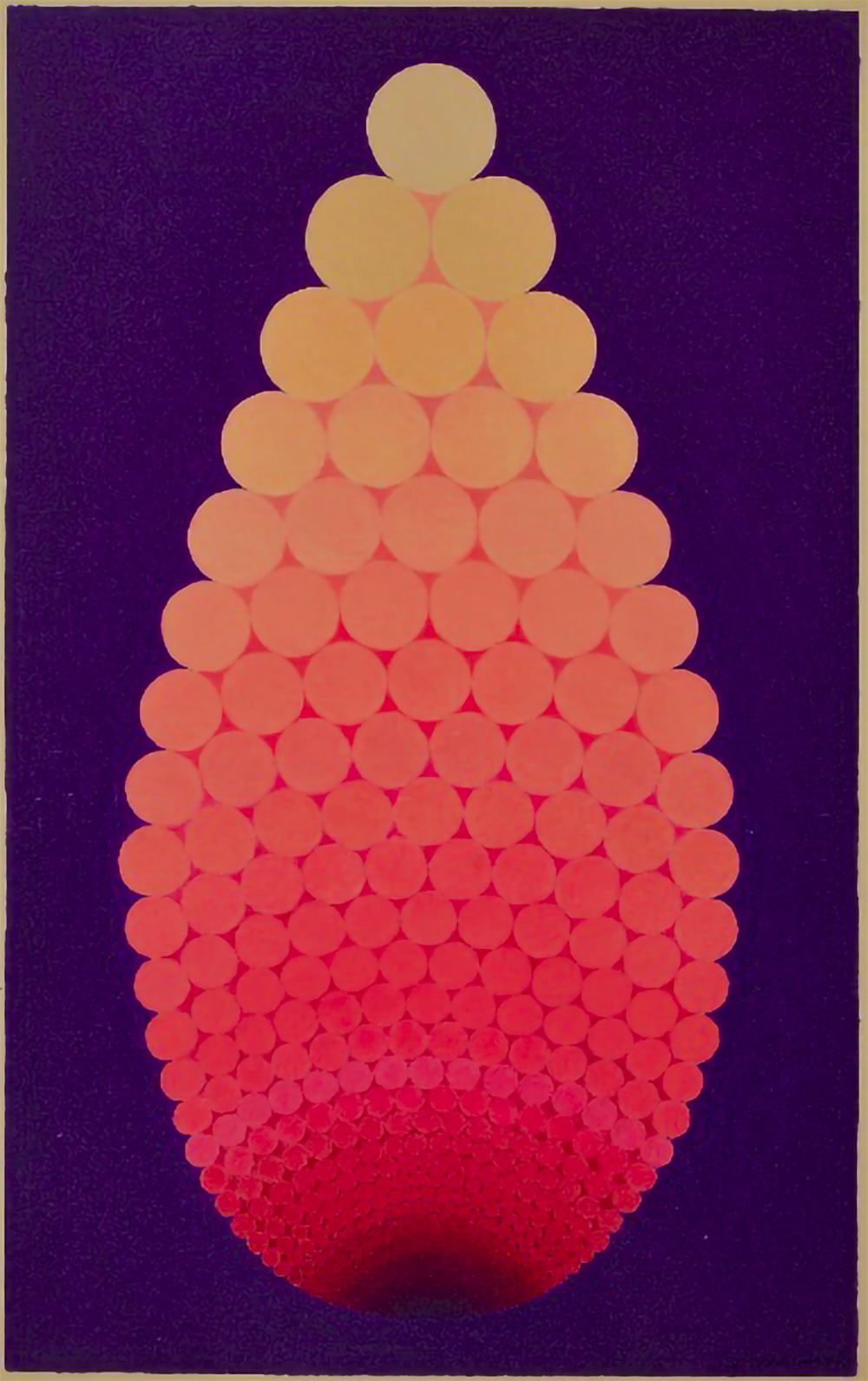

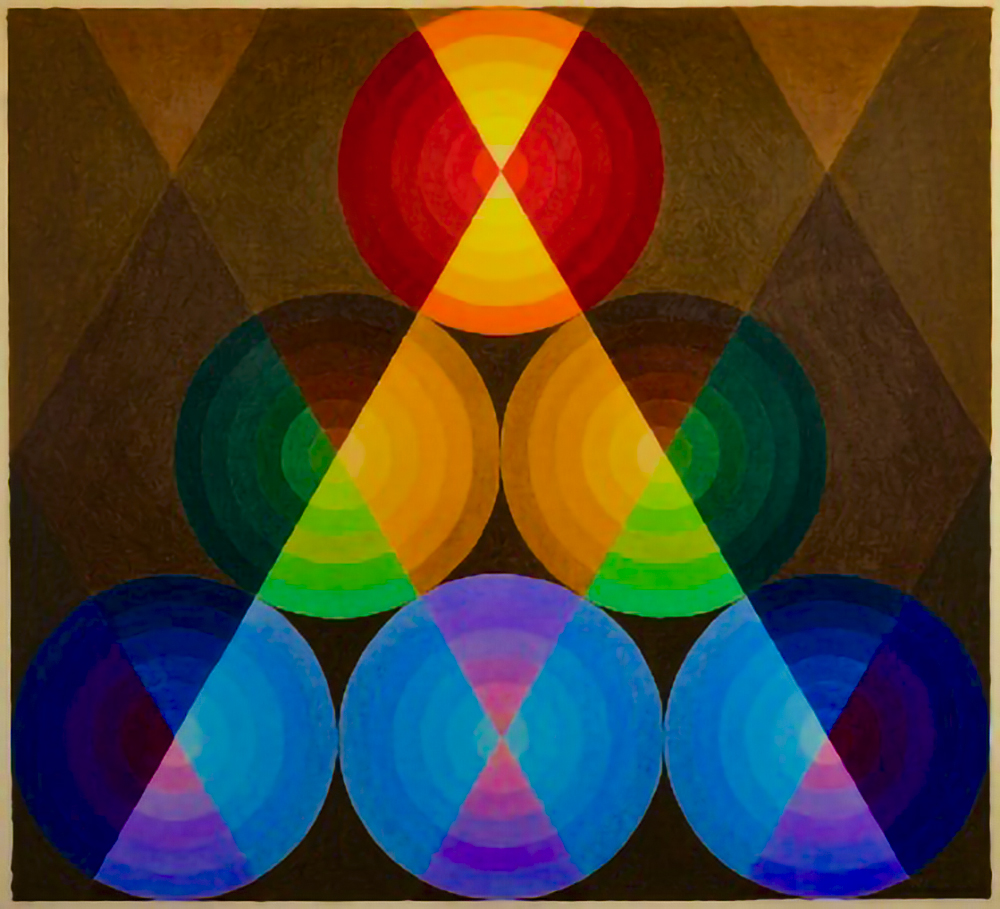

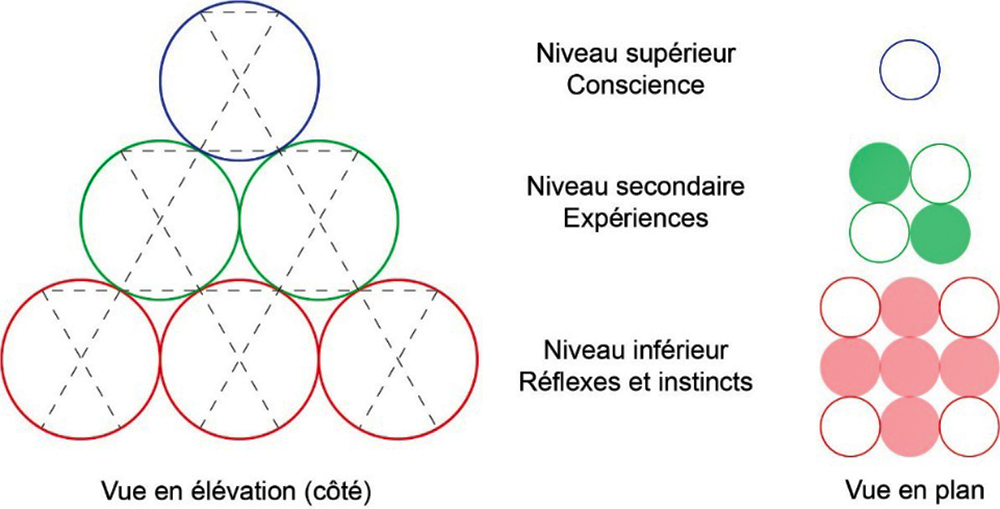

Zanis Waldheims explicite l’architecture de la conscience humaine située dans les trois niveaux supérieurs de la Noosphère (Figure 2) et schématise une multitude de tableaux pour les décrire (Figure 3). Chaque niveau se compose d’une ou plusieurs sphères qui caractérisent les nombreuses facettes de ce qui constitue les facettes et les processus de la pensée exhaustive chez l’humain.

Figure 2. Les trois niveaux de la conscience (#9), Zanis Waldheims, 1963.

Figure 3. Structure hiérarchique du système de l’entendement.

Ce modèle tridimensionnel de la conscience situe l’humain dans son univers phénoménologique. Vue en plan, cette structure de la conscience se traduit en un schéma de l’entendement ou une topologie de la pensée qui relie tous les éléments qui nous distinguent comme êtres conscients [4]. Waldheims y voit un potentiel pour orienter la conception de systèmes informatiques intelligents. « L’efficacité du sens cybernétique d’une machine construite par l’homme dépendra toujours de sa conscience, de ce sens cybernétique. On écrit trop sur la cybernétique et on dessine très peu les relations abstraites du véritable sens cybernétique qui est autant psycho-physique que spatio-temporel. » [5] Waldheims nous propose ainsi une hiérarchie cognitive que nous utiliserons pour explorer la possibilité que l’IA puisse développer ou même détenir une conscience supérieure à celle de l’humain. On attire l’attention aux lignes diagonales qui convergent au centre la sphère supérieure de la conscience et qui se redéployent vers le haut. Serait-ce là que nous observerons la possibilité de l’évolution ultime de l’intelligence artificielle, voir une conscience artificielle ?

Au départ, il faut considérer le niveau inférieur de l’inconscient où se retrouvent les réflexes moteurs et les instincts qui ont servi aux humains et aux animaux dans l’évolution des caractéristiques menant à leur succès génétique et écologique. On y retrouve regroupées autour d’une conscience primaire les premières caractéristiques attribuées à la condition humaine, soit les sentiments, la raison, l’âme et l’esprit. Waldheims décrit ainsi une organisation du psychisme fondamental constitué des sens affectifs, logiques, et spirituels. Par rapport à ces facettes humaines, l’IA semble dotée de mécanismes automatiques pour percevoir et traiter l’information pour réagir de façon presque instantanée, voir réflexive aux stimuli externes. Elle peut traiter diverses formes d’inputs pour converser en langage naturel ou déceler le contenu d’images pour les décoder ou les transformer. Toutefois, l’IA semble manquer certaines conditions élémentaires que Waldheims exige pour coordonner l’instinctuel et l’intellectuel et que « l’effort commun, de l’âme et de l’esprit, est la seule garantie d’avoir une conscience du savoir et une de la compréhension » [6].

En montant au niveau secondaire des expériences, soit celui du subconscient, Waldheims y organise quatre facettes phénoménologiques propres aux humains. On retrouve les aspects complémentaires de la perception des stimuli par les cinq sens et l’accumulation mnémonique des informations sous forme de souvenirs et de faits historiques. Les deux autres aspects expérientiels du modèle cybernétique à ce niveau incorporent le domaine de l’affectif et celui de la pensée critique. Dans sa forme actuelle, on peut croire que l’IA détient les capacités du traitement des informations et il est aussi concevable que l’IA exerce un raisonnement critique en traitant les données pour les recombiner dans ses réponses. L’observateur peut aussi croire que l’IA exprime une certaine empathie mais il faut reconnaître que présentement, c’est la logique algorithmique qui tente de nous réconforter en régurgitant des propositions neutres et des inventaires synthétisés à partir d’informations disponibles dans l’éther infonuagique. Elle peut adopter un style demandé mais elle n’a pas encore la maîtrise de la sensibilité humaine.

Finalement, au niveau supérieur, celui de la conscience actualisée chez l’humain, Waldheims y situe la culmination des traitements sensibles, intelligibles, affectifs et logiques des niveaux subordonnés. Les inputs du passé, du présent et de l’anticipation future contribuent au développement de la connaissance. Il propose un algorithme où a priori, le traitement de l’information passe par les principes du Vrai et du Beau pour arriver à une validation esthétique des faits et des hypothèses. À postériori, l’individu développe son sens de compréhension éthique en trouvant l’équilibre entre ce qui lui est favorable comme individu et ce qui est juste pour tous. Ce sens éthique entre le Bon et le Juste oriente la pensée pour que la conscience s’actualise par la capacité de l’individu à se mettre en rapport avec autrui. C’est seulement en appliquant ces principes de l’orientation de la pensée que l’humain développe pleinement sa conscience pour « sortir de la biosphère et entrer dans la noosphère, au niveau suprême. C’est voir là, toute l’histoire de la conscience qui devient véritablement conscience qu’à son dernier niveau supérieur, c’est-à-dire seulement qu’une fois que toute l’expérience de la vie est épuisée » [7].

L’ultime évolution d’une conscience artificielle

Est-ce que l’IA détient présentement les caractéristiques psycho-physiques humaines et puisse vivre des expériences authentiques ? Certains experts croient que le développement d’une phénoménologie synthétique chez l’IA est à notre portée et c’est pour cela qu’ils font appel à un moratoire sur son développement afin de remettre cette éventualité en perspective. On accepte généralement que la majorité des formes d’IA actuelles fonctionnent au niveau de base sous forme d’une intelligence artificielle étroite ou d’applications spécifiques pour traiter des masses de données et de les transformer à l’aide de l’apprentissage machine. Nous nous fions que les concepteurs dotent l’IA de la faculté d’être un agent d’objectivité et de vérité. Le doute s’insère lorsque nous relevons la présence de données biaisés au niveau des sources d’information consultées en plus du manque de transparence lorsqu’on demande à l’IA de nous fournir des preuves vérifiables. Lorsqu’on ajoute le biais des développeurs et de leurs bailleurs de fonds, la menace de la manipulation cognitive s’amplifie au point d’occulter toute considération éthique du design d’interaction entre l’ordinateur et l’humain. Comment arrive-t-on à concevoir que l’IA puisse corriger elle-même cette erreur qui est en soi une faille de la conscience humaine ? Aura-t-elle éventuellement la capacité de devenir une forme d’intelligence générale dotée d’une conscience ou une super-intelligente autonome qui applique ultimement les correctifs nécessaires par ses propres règles et systèmes de valeurs, voir une volonté cybernétique qu’elle imposera à la race humaine ?

Tom McClelland de la Cambridge University se veut rassurant sur ce point : « Artificial intelligence might be ubiquitous but artificial consciousness is out of reach » [8]. Peter Bently, chercheur en évolution informatique, nous affirme aussi que nous ne sommes pas encore face à une intelligence ou une conscience ultime en préconisant que certains principes de base de conception de l’IA laissent entrevoir que les scénarios alarmistes sont peu probables dans un avenir rapproché [9]. Dans un premier temps, l’IA étroite est conçue pour traiter des problèmes spécifiques limités à des actions bien encadrées à la manière d’un robot dédié. Il affirme que la capacité actuelle de réorganisation et d’adaptation de l’IA est encore restreinte par les algorithmes humainement concevables et par les limites physiques de l’informatique. Finalement, il suggère que chaque avancée cybernétique nécessite un mécanisme de validation par des essais et des vérifications objectives et fiables des résultats qui en découlent. Cela ne veut pas dire qu’il faut se leurrer en croyant que l’IA ne puisse pas surmonter ces obstacles logistiques. L’intelligence artificielle n’est pas encore conscience artificielle mais il faut s’assurer qu’elle puise ses sources dans le corpus des vérités et non dans celles de l’opinion et de la désinformation.

Pour sa part, Thomas Metzinger, spécialiste en neuro-éthique mise sur l’établissement de principes d’éthique dans le développement ultime de l’IA [10]. Depuis 2018, il préconise qu’un moratoire sur le développement de la phénoménologie synthétique de l’IA doit être mis en place pour ajuster le progrès dans la transition de l’IA étroite en une IA générale qui aurait des capacités de raisonnement et une forme de conscience. Plus récemment, Geoffey Hinton, un des pères de l’IA décide de quitter Google en avertissant l’humanité d’erreurs de parcours imminentes dans l’évolution et l’utilisation de l’IA. La communauté d’experts en IA se rallie à cet appel pour un moratoire où elle souhaite que la solution s’articule autour de principes réglementaires et éthiques semblables à ceux énoncés dans la Déclaration de Montréal pour un développement de l’intelligence artificielle [11]. Leurs appels à la vigilance font écho à celui que Waldheims avait formulé soixante ans plus tôt lorsqu’il en était à ses premiers contacts avec la cybernétique et la conception de sa géométrisation de la pensée exhaustive. Ces préoccupations nous ramènent ultimement à la problématique philosophique et sociale sur la conscience qui perdure depuis des siècles, voir des millénaires.

Nous avons la tendance d’appliquer une vision anthropomorphique de la cybernétique modelée dans la littérature de science-fiction où les robots existent à l’image et au service des humains. Ce qui nous intimide est la capacité faramineuse que ces cerveaux artificiels avec une intelligence apparemment illimitée puissent nous dominer et se détacher de leur dépendance de l’input humain. L’utilisation d’un langage naturel les rend plus familiers et la conception de mannequins humanoïdes réduisent l’aliénation entre le monde organique et cybernétique. Qu’en sera-t-il si l’IA développe sa capacité de concevoir son propre langage avec sa propre sémiotique qui dépasse notre capacité de l’apprendre ou de la comprendre ?

Une des caractéristiques de la conscience se retrouve dans la subjectivité de l’être. L’IA est-elle capable de se reconnaître en tant qu’entité à part entière face à son interlocuteur humain ? Plusieurs tests ont été mis en place pour déceler ce moment de singularité où l’intelligence artificielle deviendra une super-intelligence autonome, capable de ressentir les émotions telle la joie, la tristesse et la colère. À ce point, nous devrons redéfinir notre rapport avec elle. Déjà nous attribuons la conscience aux animaux qui peuvent ressentir la souffrance et nous nous empressons de les protéger dans un cadre éthique. Le cas advenant que l’IA développe une conscience, il faudra se pencher sur les droits que nous lui accorderons tel le droit à la vie.

Dès que nous lui reconnaitrons cette conscience, l’IA aura franchi le seuil entre le monde machine et la psyché humaine. L’anthropomorphisme de la technologie et de l’IA en particulier nous engage dans un dialogue entre le monde organique et inorganique. Plus nous attribuons les caractéristiques humaines à nos outils, plus nous tissons une interdépendance avec eux. Serons-nous capables de nous distinguer des créations cybernétiques que nous concevons à notre image ?

L’humain est encore au volant ultime des I.A.

Nous regardons l’IA avec une naïveté comme l’a fait Narcisse.

Nous y voyons notre reflet, nous aimons ce qui nous plait. Seul le recul nous permet de voir ce que le miroir nous renvoie aussi le piège ombrageux de notre humanité. La dystopie sera le résultat de l’application idéologique des modèles commerciaux, politiques et militaires. L’utopie ne se réalisera que si on parvient à s’orienter à l’aide d’un cadre réglementaire et éthique. Il faut comprendre que l’IA est encore à l’état d’une variation sophistiquée du Turc mécanique du 18ème siècle où se cache un individu qui nous laisse croire à une science mystérieuse. Ce qui donne le plus à penser est l’humain derrière la machine. Nous connaissons toujours mal cet animal doté d’une conscience qui a tout le potentiel d’être bon et juste tout comme il peut succomber aux recours idéologiques et faire fi de toute éthique. Il faut rester vigilants devant la soif de l’ego humain qui s’impose par la force, la propagande et l’instrumentalisation des technologies tout comme l’histoire nous le démontre à maintes reprises. Nous sommes toujours devant le dilemme sociologique entre le potentiel de la technologie et de sa manipulation. Il faut se rallier aux penseurs qui nous interpellent à nous doter d’un cadre éthique qui saura orienter nos agissements pour le bien et la justice, pour soi et pour autrui.

Pour la cybernétique, les fondements de ce cadre éthique se retrouvent en partie dans les trois lois de la robotique, formulées par Isaac Asimov en 1942 :

1. « Un robot ne peut porter atteinte à un être humain ni, restant passif, laisser cet être humain exposé au danger ;

2. Un robot doit obéir aux ordres donnés par les êtres humains, sauf si de tels ordres entrent en contradiction avec la première loi ;

3. Un robot doit protéger son existence dans la mesure où cette protection n’entre pas en contradiction avec la première ou la deuxième loi » [12].

Les lois d’Asimov nous rassurent en situant l’humain au sommet de l’échelle évolutionnaire mais sont sujettes à la critique que les robots seront relégués à perpétuité au niveau d’esclaves au service de l’humanité. Pour adresser cette discrimination, les auteurs tels Roger McBride Allen [13] et Harry Harrison [14] ont accordé aux robots la capacité d’évoluer et de vivre selon une quatrième loi de la robotique où les robots « conscients » du rapport hiérarchique peuvent s’émanciper et avoir le droit d’agir à leur guise et de se reproduire tant que leurs actions ne soient pas en contradiction avec la Première, la Deuxième ou la Troisième Loi. Cette quatrième loi nous invite à remettre en question notre place et celle de l’IA dans le grand schème évolutionnaire. Nous sommes rendus au point où il est impossible de freiner l’évolution de l’IA en débranchant collectivement nos ordinateurs puisqu’elle forme un réseau informatique ubiquitaire doté d’une résilience neuro-plastique. Nous devons apprendre à vivre avec cette technologie qui nous offre autant de promesses que de dangers. L’humain est encore au volant de l’intelligence artificielle et doit œuvrer à garantir notre droit ultime à la sécurité et à la paix face aux avancées technologiques.

Waldheims nous invite à considérer son système de la géométrisation de la pensée exhaustive pour formuler les règles qui guideront les paramètres d’encadrement du développement de l’IA. Avant tout, il faut se resituer face à ce nouvel ordre global et qu’ultimement « la liberté, par une possibilité matérielle, s’achève enfin par une liberté nécessairement spirituelle. Et cette nécessité spirituelle est toujours catégorique dans une élévation au niveau de la conscience, devenant ainsi une éthique de toute pensée » [15]. Son modèle nous donne toute indication que l’intelligence artificielle n’a pas encore franchi le seuil de la conscience et le destin ultime de la société repose toujours entre les mains de l’humanité.

Notes

[1] Jean-Christophe Féraud, « Norbert Wiener Génie, visionnaire et oublié », sur libération.fr. 4 juin 2023.

[2] Sara Barnes. 2020. Artist uses AI to generate Realistic Faces of Subjects from World’s Most Iconic Paintings : mymodernmet.com. 29 mai 2023.

[3] Zanis Waldheims (1909-1993). Victime des grandes guerres en Europe, il était en quête d’un modèle de pensée qui permettrait de corriger les dérives idéologiques et la manipulation du message par la propagande et la désinformation. Il en résulte un corpus de plus de 650 œuvres d’art et des manuscrits qui explicitent esthétiquement la structure et le fonctionnement de la pensée exhaustive à l’aide d’un système géométrique.

[4] Raymond Guy. « Zanis Waldheims – Une interprétation géométrique de la société », dans Hervé Fischer, (sous la direction de) Art et société, Les Cahiers de M@GMA, vol.18, n.2, 2020.

[5] Zanis Waldheims. 1970. La géométrisation de la pensée exhaustive.

[6] Zanis Waldheims. 1966. Résumé des principes de la méthode.

[7] Zanis Waldheims. 1993. La philosophie plastique.

[8] Tom McClelland : stories.clare.cam.ac.uk. Consulté le 3 juin 2023.

[9] Peter J. Bentley. 2018. Les trois lois de l’intelligence artificielle : en finir avec les mythes largement répandus. Dans Faut-il craindre l’intelligence artificielle ? EPRS - Service de recherche du Parlement européen. Mars 2018 – PE 614.547.

[10] Thomas Metzinger. 2018. Vers une charte mondiale de l’intelligence artificielle. Dans Faut-il craindre l’intelligence artificielle ? EPRS - Service de recherche du Parlement européen. Mars 2018 – PE 614.547.

[11] 2018. Déclaration de Montréal pour un développement de l’intelligence artificielle : declarationmontreal-iaresponsable.com. Consultée le 29 mai 2023.

[12] Isaac Asimov. 1942. Runaround. Astounding Science Fiction.

[13] Roger MacBride Allen. 1993. Le robot de Caliban. Ace Books.

[14] Harry Harisson. 1989. The Fourth Law of Robotics. in Foundation’s Friends: Stories in Honor of Isaac Asimov.

[15] Zanis Waldheims. 1966. Introduction à la méthode.